La encrucijada del dato en las organizaciones públicas

Las entidades y organismos públicos en España tienen muchos datos. Pero no siempre es fácil extraer todo el valor que esos activos tienen. Un reciente encuentro ejecutivo de la Comunidad ByTIC que tuvo la colaboración de MasOrange y Oracle, puso sobre la mesa hasta qué punto los datos se han convertido en un activo estratégico para las administraciones públicas, pero también la distancia que aún separa el discurso de la práctica.

Varias de las personas participantes coincidieron en que las decisiones empiezan a apoyarse de forma sistemática en la información disponible, aunque muchos procesos siguen anclados en inercias organizativas, resistencias culturales y graves problemas de calidad y gobernanza del dato.

Alicia Nieto Ramos, Consejera en la División General del Dato del Ministerio para la Transformación Digital, subrayó que el debate ya no es tanto si se toman decisiones con datos como desde qué referencia se parte y con qué madurez. A su juicio, el verdadero reto es dejar de entender el dato como un subproducto administrativo para convertirlo en un recurso estructural de la acción pública, con reglas claras de semántica, interoperabilidad y responsabilidad. En su intervención advirtió de que la administración ha avanzado, pero arrastra un problema de origen: “Seguimos discutiendo si la decisión está o no respaldada por datos cuando lo que deberíamos preguntarnos es qué tipo de datos, con qué calidad y bajo qué reglas estamos trabajando”.

Desde el Ayuntamiento de Madrid, Javier de Lucas, Jefe de Servicio de Analítica de Datos, situó el foco precisamente en la calidad. Recordó que cualquier organización que pretenda apoyarse en la analítica avanzada tiene que empezar por un ejercicio poco vistoso pero imprescindible: clarificar de quién es cada dato, quién responde por su exactitud y qué significan exactamente los campos que circulan entre sistemas. “Si el área de negocio no se implica en definir reglas de calidad ni en acordar la semántica, el análisis al que llegaremos puede ser brillante desde el punto de vista técnico, pero carecer de sentido para la organización”, advirtió. Para De Lucas, la clave no está solo en disponer de herramientas, sino en que las distintas unidades de la administración asuman que la definición y el contexto de los datos forman parte de su responsabilidad cotidiana.

Esa exigencia de involucrar a toda la organización apareció una y otra vez en el debate. Los ponentes coincidieron en que el analista de datos no puede actuar como un “traductor aislado” que intenta dar coherencia a información fragmentada y mal gobernada. De Lucas lo expresó con claridad al reclamar que cualquier empleado público, con independencia de su nivel jerárquico, entienda qué le aporta el dato, qué puede hacer con él y qué implicaciones tiene en su trabajo diario. “Necesitamos que en todos los niveles se sepa qué permiten los datos, cómo se pueden usar para ser más eficientes y prestar un mejor servicio”, sostuvo, enlazando la cultura de datos con la propia legitimidad de la administración ante la ciudadanía.

La conversación derivó hacia el papel de la inteligencia artificial en este contexto, no tanto como fin en sí misma, sino como palanca para ampliar el acceso a la información y automatizar análisis que hoy son costosos. De Lucas apuntó que, con las capacidades actuales, un empleado sin formación técnica avanzada puede obtener respuestas sofisticadas si es capaz de explicar con precisión al sistema qué necesita saber. “La cuestión es decidir si invertimos más en capacidades internas o si aprovechamos lo que la IA ya ofrece para que alguien, sin conocimientos especializados, pueda plantear al sistema: necesito saber si cumpliré los plazos o si podré reforzar un servicio de inspección a tiempo”, planteó. Esta visión desplaza el foco desde la herramienta a la formulación de las preguntas y a la claridad de los objetivos de gestión.

Dependencia tecnológica en el dato

Esa misma tensión entre capacidad interna y dependencia tecnológica apareció también cuando se habló de los grandes modelos de lenguaje y de los riesgos de entrenar sistemas críticos con información pública de internet. Varios de los participantes alertaron de que la conversación sobre IA en el sector público no puede desligarse de la soberanía del dato y de la protección de información estratégica. Se puso como ejemplo la posibilidad de que modelos generalistas, entrenados masivamente con datos abiertos, acaben aproximándose a ámbitos tan sensibles como la defensa, la seguridad o determinados servicios esenciales. “Los modelos se entrenan con todo lo que encuentran y hablamos de seguridad y soberanía estratégica; hay que tener claro qué se hace con los datos que salen de nuestras organizaciones”, subrayó uno de los intervinientes, apelando a una reflexión más profunda sobre qué se externaliza y en qué condiciones.

En el ámbito científico, Mar Fernández, Secretaría General Adjunta de Informática del CSIC, explicó que su organización tiene una complejidad añadida frente a otras administraciones: gestiona, además de datos administrativos, un volumen ingente de datos de investigación. Recordó que el CSIC está obligado a cumplir los principios FAIR y el mandato de ciencia abierta, lo que introduce requisitos adicionales de catalogación, accesibilidad, documentación y reutilización de la información. “Somos una administración peculiar porque, además de expedientes, tenemos datos científicos que deben ser localizables, accesibles, interoperables y reutilizables, y al mismo tiempo cumplir el mandato de ciencia abierta”, señaló. Esa doble dimensión obliga a planes específicos de conservación y a políticas de almacenamiento capaces de gestionar desde resultados experimentales hasta colecciones masivas de datos en ámbitos como la física o la astronomía

Fernández puso un ejemplo particularmente gráfico de la fragilidad del patrimonio científico cuando no se aborda de forma sistemática la gestión del dato. Relató el caso de un paciente con una infección en una prótesis mandibular implantada décadas atrás en el Hospital Universitario Gregorio Marañón, que obligó a rescatar documentación en papel para identificar el modelo exacto. “Tuvimos que ir a buscar documentos en papel para saber exactamente qué se le había colocado; son historias clínicas que acaban en cajas o en lo que ahora llamamos (entre comillas) basura”, explicó, subrayando el riesgo de perder información crítica por decisiones de almacenamiento cortoplacistas. A su juicio, la discusión sobre cuánto se guarda y en qué formato no es meramente técnica: condiciona la continuidad asistencial, la investigación y la capacidad de regenerar conocimiento.

Enrique Belmonte Maldonado, Subdirector de Sistemas de Información y Transformación Digital del Hospital Universitario Gregorio Marañón, recogió esta idea y la conectó con el valor de los datos clínicos y de investigación, tanto para la salud individual como para la planificación de servicios. Insistió en que, en sanidad, la disyuntiva entre simular y regenerar información tiene implicaciones éticas y prácticas de primer orden. “No estamos hablando de simular, hablamos de regenerar, de repetir procedimientos sobre personas reales; no podemos llamar a un paciente y repetir una intervención porque nos falta un dato”, enfatizó. Belmonte recordó que, en este campo, la decisión de conservar o no determinados datos no se reduce a un cálculo de coste de almacenamiento: puede marcar la diferencia entre un diagnóstico adecuado y una situación irreversible.

Hablemos de coste

La cuestión del coste apareció también vinculada a los grandes volúmenes de información generados por determinadas disciplinas. Fernández mencionó que en áreas como la física o la astronomía la cantidad de datos que se producen por segundo llega a ser difícil siquiera de describir, lo que obliga a preguntarse qué parte se almacena y qué parte se descarta de forma sistemática. En paralelo, surgió el debate sobre si, en algunos casos, podría ser más eficiente regenerar o recalcular una información a partir de modelos y simulaciones que almacenarla de forma exhaustiva. Uno de los ponentes planteó la idea con un ejemplo: “Si tienes un modelo que simula el comportamiento del Mediterráneo bajo distintas condiciones y dispones de todas las variables, quizá sea más razonable simular que guardar todos los datos posibles de cada escenario”. Sin embargo, otros matizaron que esa lógica no es fácilmente trasladable a contextos como la sanidad o la historia clínica, donde el tiempo y las condiciones originales no son replicables.

En el terreno de los seguros, Carmen García Roger, Directora de Sistemas y Tecnologías de la Información del Consorcio de Compensación de Seguros, describió la dificultad de detectar fraudes en un entorno en el que la información llega por canales muy diversos y con niveles de estructura muy dispares. A su juicio, el fraude es solo “la parte más visible de un problema más amplio de duplicidades y errores”, derivado de la dispersión de sistemas y bases de datos. “La detección de fraude es muy compleja por la cantidad de vías por las que nos llega la información, pero probablemente el mayor problema sea la duplicación y la inconsistencia: para las empresas y para la ciudadanía el resultado es un auténtico desastre”, señaló. García Roger incidió en que, sin una buena vinculación de datos, resulta imposible ofrecer una visión unificada de la relación del ciudadano con la entidad, lo que afecta tanto al control de riesgos como a la calidad del servicio en situaciones críticas.

La propia utilización de IA para abordar estos retos fue objeto de un intercambio específico. García Roger explicó que el modelo que están utilizando no parte de cero, sino que llega ya entrenado con grandes cantidades de información previa. “La IA que usamos viene ya entrenada, ha aprendido con datos, con datos puros, no es un lienzo en blanco”, apuntó. Desde otro de los participantes se advirtió de los riesgos de esa aproximación: “Ahí está el problema, llega entrenada con datos que no siempre son correctos, y lo aprendido no siempre es válido para nuestro contexto”. El diálogo reflejó una preocupación compartida: cómo controlar el sesgo y la fiabilidad de modelos que se aplican sobre conjuntos de datos institucionales para tomar decisiones con efectos directos sobre las personas.

Desde el ámbito de la infraestructura y la logística, Daniel López Limón, Subdirector de Infraestructuras en Correos, aportó la perspectiva de una entidad que combina grandes volúmenes de datos operativos con necesidades muy concretas de optimización y planificación. Una parte de la discusión giró en torno a la necesidad de priorizar qué procesos se normalizan primero, con qué reglas y con qué alcance organizativo. López Limón incidió en la importancia de resolver los problemas de silos, tanto tecnológicos como culturales. “Puedes tener un gran despliegue de infraestructura, pero si cada área decide que se guarda sus datos en su ‘unidad C’ y no los comparte, el modelo de administración basada en datos no funciona”, señaló, recogiendo una de las frases que se repitió en la sesión: la tentación de conservar información de forma individual sin integrarla en una estrategia global.

El fenómeno de los silos no se limita a las organizaciones con estructura territorial o jerárquica compleja. Fernández relató el caso del CIC bioGUNE como ejemplo de hasta qué punto las dinámicas personales condicionan la gestión del conocimiento. “Somos 18 000 personas y tenemos 34 000 cuentas de correo, nadie es capaz de eliminar la cuenta de un investigador jubilado porque ahí tiene toda su vida científica”, explicó, aludiendo a un estudio sobre el uso del correo electrónico como repositorio informal de artículos, datos y material de investigación. La resistencia a cerrar cuentas se mezcla con la obligación de preservar la producción científica, generando un escenario en el que los sistemas oficiales conviven con prácticas que escapan a los marcos de gobernanza. Fernández admitió que esta situación tensiona las políticas de seguridad, hasta el punto de que “en el CCN se desesperan con nosotros porque piden más atención para la seguridad de la investigación que para otros ámbitos”.

La dimensión económica del dato atravesó también la conversación. Alicia Nieto mencionó explícitamente la “economía del dato” como marco para entender el valor generado, no solo en términos monetarios, sino también en eficiencia, transparencia y capacidad de innovación. Recalcó, sin embargo, que garantizar la interoperabilidad sigue siendo extraordinariamente complejo, sobre todo en su vertiente semántica. “Hablamos de dar valor económico a los datos, pero asegurar la interoperabilidad, y en especial la parte semántica, es una tarea enorme”, advirtió. Esta visión conecta con las exigencias europeas en materia de espacios de datos y reutilización de información pública, donde la alineación de significados resulta tan importante como la compatibilidad técnica.

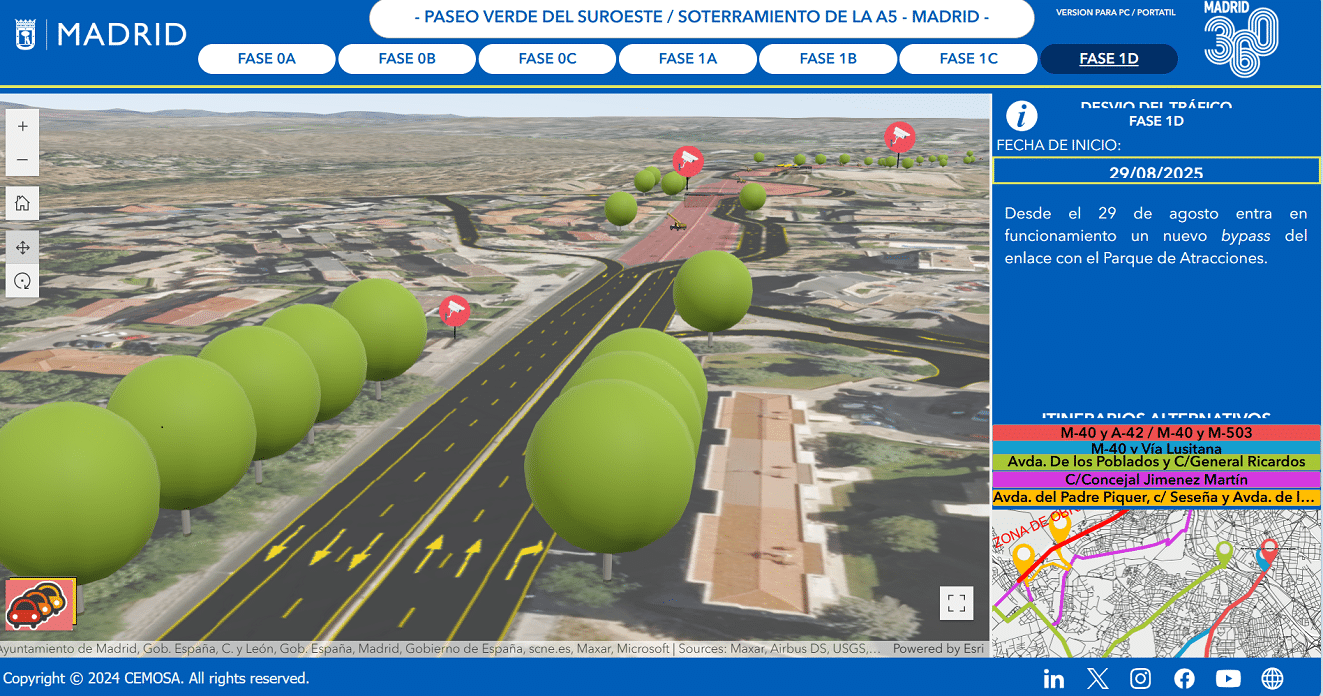

El coste de procesar y poner a disposición conjuntos de datos a gran escala apareció con fuerza cuando se analizó el proyecto Mobility for You, en el que participa MasOrange junto a administraciones como el Ayuntamiento de Madrid. Arturo Malagón, Responsable de Servicios Digitales Big Data e IA en MasOrange, y otros intervinientes explicaron que se trata de una iniciativa financiada con fondos públicos en la que el operador actúa como socio de un consorcio, con obligaciones y contraprestaciones definidas, pero sin comprometerse a mantener el modelo una vez finalice el proyecto. “Es un proyecto de innovación con requisitos y contraprestaciones; no les compromete a seguir con ese modelo cuando termine, sirve para explorar posibilidades y potencialidades”, aclaró uno de los participantes al describir el marco del consorcio. La idea de fondo es que este tipo de proyectos permiten experimentar con nuevos esquemas de compartición de datos de movilidad sin obligar a las partes a consolidar desde el primer día un modelo de negocio definitivo.

En ese contexto, se comentó el cálculo del coste de procesamiento cuando una entidad como el Ayuntamiento de Madrid pide datos agregados sobre movilidad, por ejemplo, del sistema de transporte en superficie. Malagón recordó que, en una conversación reciente, estimaron en torno a un millón de euros el coste de procesar los datos con el nivel de desagregación que se demandaba. “Hicimos el cálculo y el coste de procesar los datos como los pedía Madrid se acerca al millón de euros”, señaló, evidenciando la brecha entre las expectativas de las administraciones y los recursos necesarios para generar productos de datos de alto valor añadido. Este cálculo no se refiere solo a la infraestructura, sino también a los equipos humanos necesarios para garantizar calidad, anonimización y cumplimiento normativo.

El Ayuntamiento de Madrid aparece en este proyecto también como demandante de información para la gestión de emergencias. Se recordó cómo, durante un episodio de DANA, se solicitó a MasOrange que identificara los puntos concretos con mayor concentración de población en determinados momentos, basándose en la posición de las celdas móviles. “Para la DANA nos pedisteis datos para saber cuánta gente había en cada punto y en qué momento, a partir de las celdas”, explicó uno de los ponentes, poniendo de ejemplo un caso ya llevado a producción. Situaciones de este tipo ilustran cómo la explotación de datos de movilidad puede convertirse en una herramienta para planificar evacuaciones, desplegar servicios de emergencia o evaluar el impacto de un fenómeno meteorológico extremo, siempre bajo un marco de garantías para la privacidad.

Necesaria colaboración

La conversación abrió también un paréntesis sobre la propia naturaleza colaborativa de estos proyectos. Malagón destacó que, en el ámbito de la movilidad y otros casos de uso, existe ya una cierta “normalización” del intercambio de datos entre empresas y administraciones cuando hay un modelo de negocio definido o un proyecto concreto. “Muchas veces compartimos datos por defecto porque existe un modelo de negocio establecido o un proyecto en el que se define claramente qué aporta cada parte”, indicó. En el caso de Mobility for You, esa dinámica se traduce en un flujo constante de peticiones de conjuntos de datos para desarrollar casos de uso específicos, sobre los que las administraciones quieren experimentar sin asumir todavía compromisos a largo plazo.

Desde el Consejo de Seguridad Nuclear, Patricia López Benedi, Coordinadora de Área de la División de Tecnologías de la Información y la Comunicación, puso el acento en la sensibilidad extrema de ciertos datos y en la necesidad de combinar apertura y seguridad. Aunque la transcripción recoge su intervención de forma fragmentaria, se desprende una preocupación por garantizar que la utilización de técnicas de IA no ponga en riesgo información crítica relacionada con instalaciones, procesos o evaluaciones. López Benedi se alineó con quienes recordaron que la discusión sobre modelos generativos debe empezar siempre por la pregunta de qué datos se entregan a qué proveedores, con qué salvaguardas y bajo qué marco regulatorio. Este enfoque se conecta con las advertencias sobre los modelos entrenados con grandes corpus públicos sin control suficiente sobre la procedencia y el uso de la información.

En paralelo, José Javier Marín, Jefe de área en la Dirección General de Infraestructura del Ministerio de Defensa, subrayó el valor de los datos de la ciudadanía en ámbitos como la defensa, la salud o los servicios esenciales, insistiendo en que su tratamiento no puede improvisarse. Marín recordó que el conocimiento generado a partir de esos datos repercute en toda la población, aunque no siempre sea evidente. “Hablamos del valor de los datos de la ciudadanía en defensa, salud o servicios, pero la ciencia que se hace con esos datos es para todos los ciudadanos”, afirmó, reclamando una visión más transversal que conecte el uso de la información con los beneficios colectivos que proporciona. Al mismo tiempo, advirtió de que esa lógica no exime de extremar las garantías, especialmente cuando se trabaja con información sensible desde el punto de vista estratégico.

El debate no eludió la cuestión organizativa. Varios ponentes señalaron que muchos de los problemas en la gestión del dato y en la adopción de IA no se deben tanto a la tecnología disponible como a la forma en que se estructuran los equipos y se reparten responsabilidades. Se citaron ejemplos de duplicidad de puestos en algunas organizaciones y de puestos críticos que no se cubren cuando alguien se va de vacaciones en otras, lo que deja procesos clave sin respaldo suficiente. También se mencionó la figura del personal investigador jubilado que continúa trabajando un año más o mantiene su cuenta de correo activa porque en ella se concentra buena parte de su producción científica. “Un investigador no se jubila nunca, y eso tiene reflejo en cómo gestionamos sus datos, sus accesos y sus cuentas”, ironizó Fernández, para quien estas realidades deben afrontarse con políticas claras, más allá de las buenas intenciones.

La mesa coincidió en que avanzar hacia administraciones genuinamente orientadas al dato implica asumir prioridades y renuncias. Para De Lucas, la queja de que “no hay capacidad” para normalizar datos o depurar bases de información es, en parte, una cuestión de enfoque. “Cuando se dice que no hay capacidad para normalizar o para trabajar la semántica, en realidad estamos hablando de prioridades; si queremos que la organización funcione guiada por los datos, tenemos que dedicar recursos a que esos datos sean consumibles por todos”, argumentó. En su opinión, el riesgo de no hacerlo es construir una apariencia de sofisticación analítica sobre una base frágil, que conduce a decisiones apoyadas en una realidad que puede diferir mucho de la que se pretende gestionar.

En esta misma línea, varios asistentes se refirieron a la tentación de dejar la información “en cajas” o en repositorios poco estructurados, confiando en que el problema pueda resolverse más adelante con herramientas más potentes o con técnicas de IA. La anécdota de los documentos en papel necesarios para reconstruir el historial de una prótesis mandibular sirve como recordatorio de que algunos vacíos de información no se pueden rellenar a posteriori. “Estamos hablando de personas, no solo de expedientes”, insistió Fernández, al defender que la gestión del dato en la investigación y en la sanidad debe contemplar explícitamente el impacto sobre vidas concretas, más allá de los indicadores agregados. En este escenario, la IA se presenta como un apoyo para contextualizar información, cruzar fuentes y generar representaciones más ricas, pero no como sustituto de una política de datos sólida.

Desde la perspectiva de los proveedores de tecnología, Sergio Sáez, Vicepresidente y director del negocio de plataforma de datos y multicloud en Oracle España y Portugal, centró su intervención en la complejidad de los entornos de información de las organizaciones públicas. Señaló que, a diferencia de una empresa que nace digital y puede diseñar desde el principio un único repositorio, la administración arrastra décadas de sistemas heterogéneos. “La realidad es que la información está repartida en cientos de bases de datos, en Oracle, Postgres, Mongo y decenas de sistemas; esta dispersión es un problema en sí misma”, aseguró. Sáez defendió la necesidad de arquitecturas que permitan abstraer esa complejidad y ofrecer una capa unificada de acceso al dato, sobre la que se puedan desplegar modelos de IA sin replicar cada vez la misma integración de fuentes.

Sáez introdujo además una distinción entre los modelos generalistas entrenados con información pública y los modelos más controlados que se construyen sobre datos internos. Explicó que, en muchos casos, lo relevante es cómo se contextualiza la información de la organización en la fase de inferencia. “Lo que necesitamos es que el modelo entienda el contexto de una póliza de seguros, de una historia clínica o de un expediente administrativo, pero para eso primero hay que poner orden en los datos que tenemos repartidos en tantos sistemas”, planteó. Según su visión, la prioridad pasa por exponer los datos corporativos de forma segura y consistente, de manera que los modelos puedan usarlos sin que cada caso de uso se convierta en un proyecto de integración ad hoc.

En conjunto, las intervenciones dibujan una administración pública que ha asumido el discurso del dato y de la inteligencia artificial, pero que convive con legados documentales, estructuras organizativas rígidas y sistemas fragmentados que dificultan convertir ese discurso en práctica diaria. La insistencia en la calidad, la semántica y la gobernanza del dato se cruzó con ejemplos concretos en sanidad, investigación, seguros, defensa, logística y movilidad, todos ellos atravesados por la misma pregunta de fondo: cómo asegurarse de que las decisiones que afectan a las personas se apoyan en una representación fiel de la realidad y no en una imagen distorsionada por lagunas de información, sesgos de modelo o inercias internas. En esa encrucijada, las voces presentes coincidieron en que la IA puede ser una aliada poderosa, siempre que se aborde como parte de una estrategia más amplia que ponga el foco en el valor público del dato, la protección de la ciudadanía y la sostenibilidad de los proyectos más allá de la fase de experimentación